人类在被人工智能超越后该思考什么

2016/01/29

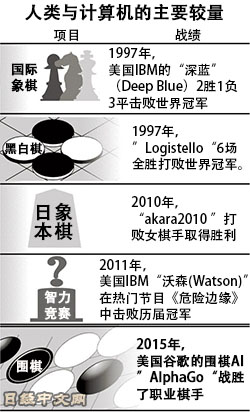

计算机胜过人类的领域又增加了一个。在此前被视为游戏领域难度最高的围棋比试中,美国谷歌的人工智能(AI)击败了职业棋手,今后有望应用于广泛领域。这一技术还有望在生活的便利化、以及解决医疗和环境等各种问题方面作出贡献。另一方面,开发方的伦理问题的重要性也在增强。

谷歌的围棋人工智能“AlphaGo”之所以能战胜职业棋手借助的是模仿人类大脑的神经回路、被称为“深度学习”的最尖端人工智能技术。谷歌采用这项技术,2015年推出了一边玩电子游戏一边找出新战术的人工智能“DQN”。创造了超过人类的高分,展现了在深度学习领域的实力。

以AlphaGo为例,首先输入协助开发的职业棋手的3000万种下法让其学习,达到能够以57%的概率预测与其对阵的人类行动的水平。

在此基础上,人工智能将自己的对战重温数百万次,在不断积累胜负经验的过程中,掌握取胜方式。在观察围棋子的整体布局的基础上选择最佳下法,这一方式接近于带着直觉和第六感作出判断的人类大脑的功能。

谷歌今后将把这一技术应用于哪些方向?主导开发的杰米斯·哈萨比斯(Demis Hassabis)明确表示,“游戏是人工智能开发和测试的极佳舞台,但终极目标是将这项技术用于解决现实社会各种问题”。作为例子,他列举了医疗图像的诊断支持等,显示出将加快通用性强的人工智能开发的想法。

不过,对于人工智能的迅速发展,警惕感也在提升。哈萨比斯表示,“完成了人工智能的‘巨大挑战’之一,感到很高兴”,另一方面,“对于伦理问题,我们也具备充分认识”。正如一部分知名人士和学者担忧的那样,也不能否认存在由于放任自流的研究开发,出现人工智能与社会敌对、给人类带来危害的可能性。

谷歌表示:“对于作为有潜力新技术的人工智能,将慎重讨论如何在符合伦理的情况下、负责任地加以发展”(哈萨比斯)。谷歌已在公司内设置了伦理委员会。在人与计算机在游戏领域的“巅峰对决”已分出高下的今天,需要的或许不再是“对决”,而是“合作”的视角。

日本经济新闻(中文版:日经中文网)硅谷 小川义也

版权声明:日本经济新闻社版权所有,未经授权不得转载或部分复制,违者必究。

|

以AlphaGo为例,首先输入协助开发的职业棋手的3000万种下法让其学习,达到能够以57%的概率预测与其对阵的人类行动的水平。

在此基础上,人工智能将自己的对战重温数百万次,在不断积累胜负经验的过程中,掌握取胜方式。在观察围棋子的整体布局的基础上选择最佳下法,这一方式接近于带着直觉和第六感作出判断的人类大脑的功能。

谷歌今后将把这一技术应用于哪些方向?主导开发的杰米斯·哈萨比斯(Demis Hassabis)明确表示,“游戏是人工智能开发和测试的极佳舞台,但终极目标是将这项技术用于解决现实社会各种问题”。作为例子,他列举了医疗图像的诊断支持等,显示出将加快通用性强的人工智能开发的想法。

不过,对于人工智能的迅速发展,警惕感也在提升。哈萨比斯表示,“完成了人工智能的‘巨大挑战’之一,感到很高兴”,另一方面,“对于伦理问题,我们也具备充分认识”。正如一部分知名人士和学者担忧的那样,也不能否认存在由于放任自流的研究开发,出现人工智能与社会敌对、给人类带来危害的可能性。

谷歌表示:“对于作为有潜力新技术的人工智能,将慎重讨论如何在符合伦理的情况下、负责任地加以发展”(哈萨比斯)。谷歌已在公司内设置了伦理委员会。在人与计算机在游戏领域的“巅峰对决”已分出高下的今天,需要的或许不再是“对决”,而是“合作”的视角。

日本经济新闻(中文版:日经中文网)硅谷 小川义也

版权声明:日本经济新闻社版权所有,未经授权不得转载或部分复制,违者必究。